Les développeurs, les codeurs et les passionnés pourraient être intéressés par un nouveau modèle d’assistant de codage d’IA open source sous la forme du grand modèle de langage (LLM) DeepSeek. Recherche profonde, une entreprise qui travaille discrètement, a récemment publié un modèle de codage open source qui fait des vagues dans la communauté technologique. Ce modèle, connu sous le nom de modèle de codeur DeepSeek, possède une capacité impressionnante 67 milliards de paramètres, le plaçant dans la même catégorie que certains des modèles d'IA les plus avancés, comme GPT-4. L'assistant de codage IA open source a été formé à partir de zéro sur un vaste ensemble de données en anglais et en chinois.

-

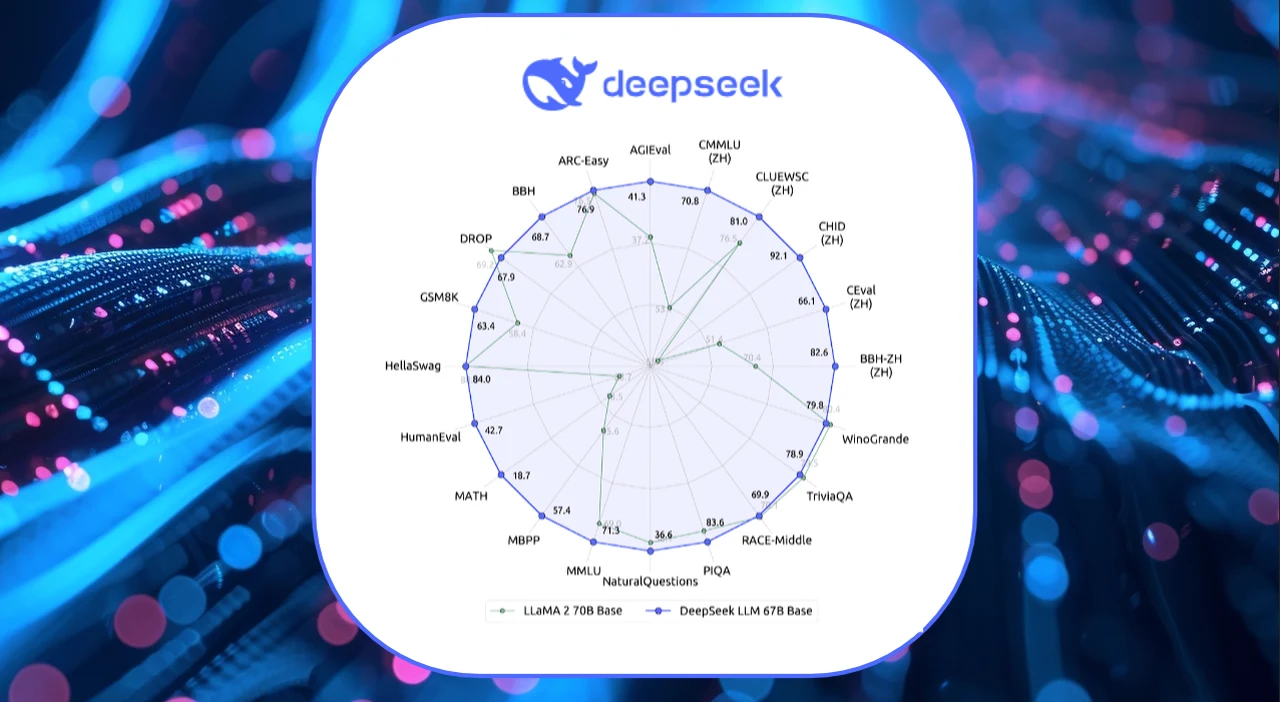

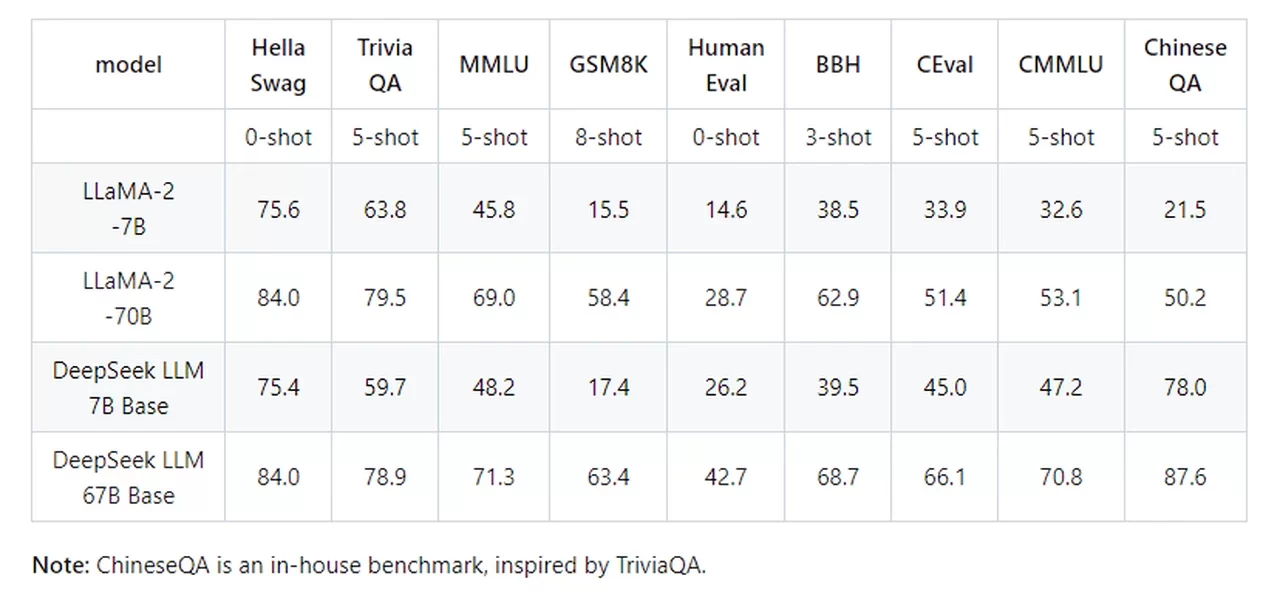

Capacités générales supérieures : Base DeepSeek LLM 67B surpasse Llama2 70B Base dans des domaines tels que le raisonnement, le codage, les mathématiques et la compréhension du chinois.

-

Maîtrise du codage et des mathématiques : DeepSeek LLM 67B Chat présente des performances exceptionnelles en codage (HumanEval Pass@1 : 73,78) et en mathématiques (GSM8K 0-shot : 84,1, Math 0-shot : 32,6). Il démontre également des capacités de généralisation remarquables, comme en témoigne sa note exceptionnelle de 65 à l'examen national hongrois du lycée.

-

Maîtrise de la langue chinoise : D'après notre évaluation, DeepSeek LLM 67B Chat surpasse GPT-3.5 en chinois.

Qu'est-ce qui fait que Modèle de codeur DeepSeek se démarquer est sa formation approfondie sur un ensemble de données comprenant deux mille milliards de jetons. Cette grande quantité de données a donné au modèle une compréhension et une base de connaissances étendues, lui permettant de fonctionner à des niveaux qui dépassent le modèle de base de 70 milliards de Llama 2 et de montrer des compétences similaires à GPT-3.5. Cette réussite en a rapidement fait un concurrent notable dans le paysage de l’IA.

Mais DeepSeek ne s’est pas arrêté là. Ils ont continuellement amélioré leur modèle. Avec la sortie de la version 1.5, ils ont ajouté un supplément 1,4 billion de jetons de codage des données à la formation du modèle, ce qui a considérablement amélioré ses capacités. Cette mise à niveau signifie que le Modèle de codeur DeepSeek est désormais encore plus apte à gérer des tâches complexes, telles que programmation en langage naturel et raisonnement mathématique. C'est devenu un outil essentiel pour ceux qui ont besoin de simplifier des processus complexes.

Assistant de codage IA open source DeepSeek

« Nous publions le DeepSeek LLM 7B/67B, comprenant à la fois les modèles de base et de chat, au public. Pour soutenir un éventail de recherches plus large et plus diversifié au sein des communautés universitaires et commerciales, nous donnons accès aux points de contrôle intermédiaires du modèle de base à partir de son processus de formation. S'il te plaît note que l'utilisation de ce modèle est soumise aux conditions décrites dans Rubrique Licence. L’utilisation commerciale est autorisée selon ces conditions.

La polyvalence du modèle mérite également d'être mentionnée une fois de plus, car il prend en charge plusieurs langues, dont le chinois, ce qui ouvre ses avantages à un public international plus large. Ceci est particulièrement important à mesure que la demande de technologies avancées d’IA augmente dans différentes régions et secteurs.

DeepSeek LLM et LLaMA 2

Pour ceux qui souhaitent utiliser le Assistant de codage DeepSeek AIil est facilement disponible sur des plateformes comme Hugging Face et LM Studio. télécharger dans les versions 7 milliards et 33 milliards. Cette accessibilité garantit que les utilisateurs qui ont besoin d’une IA de pointe peuvent facilement l’intégrer dans leur travail. Les capacités techniques du modèle sont en outre mises en valeur par sa capacité à prédire le prochain jeton dans une séquence avec une taille de fenêtre de 4K, ce qui signifie qu’il peut produire des résultats plus nuancés et plus conscients du contexte environnant. De plus, le modèle a été affiné sur 2 milliards de jetons de données d'instructions, ce qui garantit qu'il peut comprendre et exécuter des instructions complexes avec une précision remarquable.

L'équipe de recherche et développement responsable de la création de ce modèle de langage avancé unique comprenant 67 milliards de paramètres a des projets futurs pour son développement, et le Assistant de codage DeepSeek AI n’est probablement que le début de leur voyage. Ils ont fait allusion à des développements futurs qui pourraient redéfinir les limites des modèles d’IA. Cela suggère que nous pouvons nous attendre à des outils plus innovants de DeepSeek qui continueront à façonner l’avenir de diverses industries et applications.

Le Modèle de codeur DeepSeek constitue une avancée significative dans le domaine de la technologie d’IA open source. Avec ses fonctionnalités avancées et ses performances élevées, c'est une excellente option pour toute personne ayant besoin d'un modèle d'IA spécialisé dans le codage et les mathématiques. Alors que la communauté de l’IA continue de se développer, le modèle de codeur DeepSeek constitue un excellent exemple du type d’outils innovants, puissants et adaptables qui stimulent le progrès dans différents domaines. Pour donner à l'assistant de codage AI, essayez de passer au site officiel Site Web DeepSeek Alpha.

Classé sous : Actualités sur les gadgets

Dernières offres sur les gadgets geek

Divulgation: Certains de nos articles incluent des liens d’affiliation. Si vous achetez quelque chose via l'un de ces liens, Geeky Gadgets peut gagner une commission d'affiliation. Découvrez notre politique de divulgation.

Vous pouvez lire l’article original (en Angais) sur le {site|blog}www.geeky-gadgets.com