Au cours du week-end, Openai a publié son dernier modèle O3-Mini offrant une mise à niveau substantielle par rapport à son modèle O1 précédent. Ce nouvel outil de raisonnement d'IA peut désormais être utilisé pour améliorer l'automatisation du flux de travail et rationaliser le traitement des données structurées dans la plate-forme d'automatisation N8N. Lorsqu'elle est intégrée dans N8N, il déverrouille les fonctionnalités avancées telles que l'analyse de sortie structurée, l'appel des fonctions et les performances optimisées. Si vous souhaitez en savoir plus sur la façon dont vous pouvez ajouter l'O3- Mini à votre automatisation N8N. Ce guide de Leon Van Zylprovides une procédure pas à pas détaillée pour la configuration du modèle, met en évidence ses caractéristiques clés et la compare à des alternatives comme Deepseek R1.

Que vous soyez nouveau dans l'automatisation ou un pro chevronné, ce dernier modèle OpenAI offre une nouvelle approche pour lutter contre les tâches complexes avec précision et vitesse. Si vous vous êtes déjà senti enlisé par les inefficacités ou limité par les capacités des modèles d'IA plus anciens, vous n'êtes pas seul. La bonne nouvelle? Il y a une solution qui est non seulement plus intelligente mais aussi étonnamment facile à mettre en œuvre.

Quel est le modèle Openai O3-Mini?

« Openai O3-MinI est notre premier petit modèle de raisonnement qui prend en charge les fonctionnalités de développeur hautement demandées, y compris la fonction d'appel (s'ouvre dans une nouvelle fenêtre), des sorties structurées (s'ouvre dans une nouvelle fenêtre) et les messages du développeur (s'ouvre dans une nouvelle fenêtre) , ce qui le rend prêt pour la production hors de la porte. Comme Openai O1-Mini et Openai O1-Preview, O3-Mini prendra en charge Streaming (s'ouvre dans une nouvelle fenêtre). En outre, les développeurs peuvent choisir entre trois efforts de raisonnement (ouvrent dans une nouvelle fenêtre) des options – standard, moyen et haut – pour optimiser leurs cas d'utilisation spécifiques.»- Openai

TL; Dr Key à retenir:

- Le modèle Openai O3-Mini est un outil d'IA léger mais puissant conçu pour le raisonnement logique, les sorties structurées et les réponses à faible latence, ce qui la rend idéale pour l'automatisation et les applications basées sur les données.

- Les caractéristiques clés incluent un raisonnement amélioré, des appels de fonction, des invites système personnalisables et une analyse de sortie structurée au format JSON, permettant des flux de travail précis et efficaces.

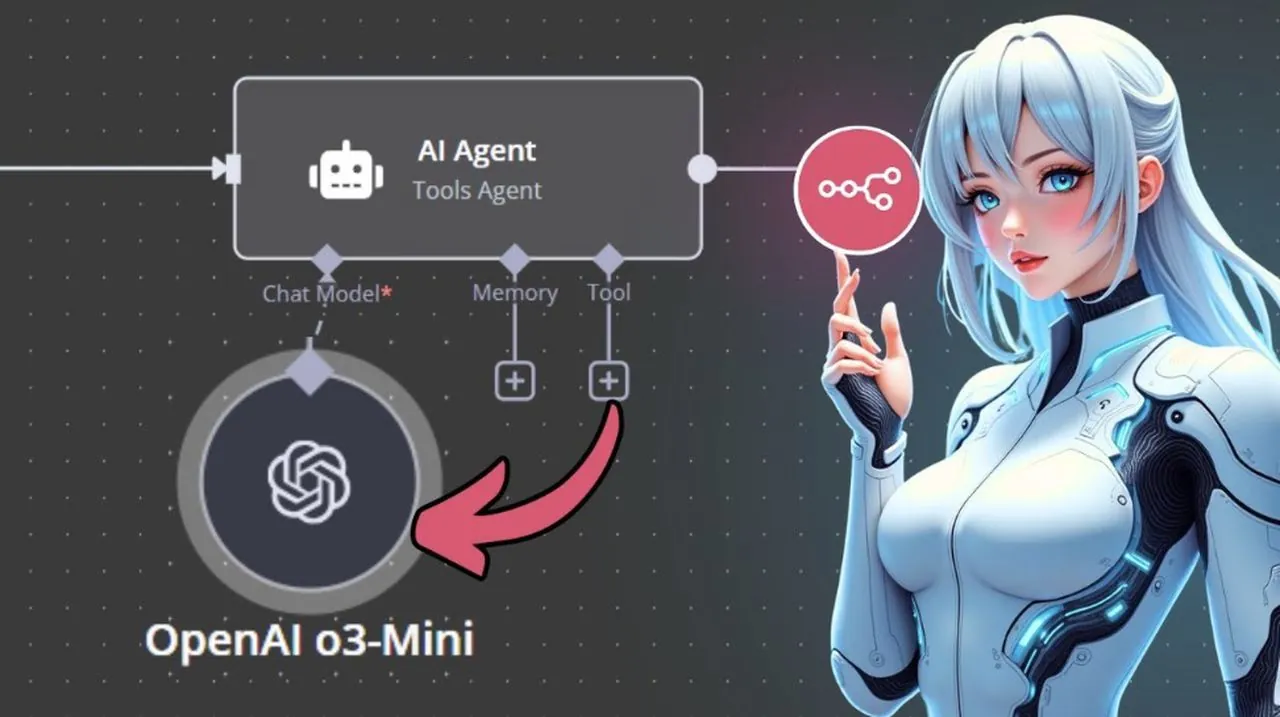

- L'intégration avec N8N est simple, nécessitant une clé API OpenAI et une configuration du nœud du modèle de chat pour l'automatisation de workflow sans couture.

- Par rapport à Deepseek R1, le modèle O3-Mini offre des performances supérieures, y compris l'appel de fonction, les sorties format par JSON et la latence plus faible, ce qui le rend plus adapté aux tâches de qualité de production.

- Les applications pratiques, telles qu'un flux de travail de recommandation de film, démontrent la capacité du modèle à fournir des sorties structurées et personnalisables adaptées à des requêtes et des critères spécifiques.

Le modèle OpenAI O3-MINI est un système d'IA léger mais très capable adapté aux tâches nécessitant un raisonnement logique, des sorties structurées et des réponses à faible latence. Il présente des fonctionnalités avancées telles que Fonction Calling et l'analyse de sortie basée sur le schéma JSON, ce qui en fait un choix idéal pour les flux de travail d'automatisation complexes et les applications basées sur les données. Par rapport aux modèles plus anciens comme Deepseek R1, le modèle O3-Mini offre des temps de réponse plus rapides et des capacités de raisonnement supérieures, ce qui le rend particulièrement bien adapté aux environnements de production où l'efficacité et la précision sont essentielles.

Comment configurer Openai O3-MinI dans N8N

L'intégration du modèle Openai O3-Mini dans N8N est un processus simple qui peut être achevé en quelques étapes. Voici comment commencer:

- Ajoutez le nœud du modèle de chat Openai à votre flux de travail N8N.

- Générez une clé API à partir de votre compte OpenAI et saisissez-le dans les paramètres de configuration du nœud.

- Si le modèle O3-Mini n'apparaît pas dans le menu déroulant, entrez manuellement son nom pour assurer une intégration appropriée.

Une fois la configuration terminée, le modèle se connecte parfaitement à vos workflows, permettant des tâches avancées d'automatisation et de raisonnement. Cette intégration vous permet d'exploiter le plein potentiel du modèle O3-Mini pour une variété d'applications, du traitement des données à la prise de décision intelligente.

Comment utiliser Openai O3-MinI dans N8N

Explorez d'autres guides et articles de notre vaste bibliothèque que vous pourriez trouver pertinents pour vos intérêts dans les automations N8N.

Caractéristiques clés de Openai O3-MinI

Le modèle Openai O3-Mini propose une gamme de fonctionnalités avancées qui en font un outil polyvalent et puissant pour l'automatisation et le traitement des données:

- Raisonnement amélioré: Le modèle excelle à gérer les requêtes complexes, les déductions logiques et la résolution de problèmes en plusieurs étapes, ce qui le rend idéal pour les flux de travail complexes.

- Fonction Appel: Il prend en charge les interactions dynamiques avec les API et les systèmes externes, permettant des flux de travail plus flexibles et réactifs.

- Invites système personnalisables: Vous pouvez guider le comportement du modèle en configurant les invites système adaptées à des tâches spécifiques, en vous assurant des sorties précises et pertinentes.

- Intégration de recherche sur le Web: En se connectant à des outils comme l'API SERP, le modèle peut récupérer des informations en temps réel sur le Web, améliorant son utilité pour les applications basées sur les données.

Ces fonctionnalités font collectivement le modèle O3-Mini un atout précieux pour automatiser les workflows, gérer des données structurées et améliorer l'efficacité opérationnelle.

Analyse de sortie structurée: une fonction hors concours

L'une des caractéristiques les plus notables du modèle O3-Mini est sa capacité à fournir des sorties structurées au format JSON. En définissant un schéma JSON, vous pouvez personnaliser les réponses du modèle pour inclure des champs spécifiques, en vous assurant que les données renvoyées sont à la fois organisées et exploitables. Par exemple, dans un flux de travail de recommandation de film, vous pouvez configurer la sortie pour inclure: nom du réalisateur, membres de la distribution, année de sortie et exécution.

Cette capacité gagne non seulement du temps mais réduit également les erreurs dans les tâches en aval en fournissant des données prêtes à être utilisées immédiates. Que vous travailliez sur l'analyse des données, les rapports ou l'intégration avec d'autres systèmes, l'analyse de sortie structurée assure la cohérence et la fiabilité.

Comment se compare-t-il à Deepseek R1?

Bien que Deepseek R1 soit un modèle de raisonnement compétent, il ne manque pas dans plusieurs domaines par rapport au modèle Openai O3-Mini. Les principales différences comprennent:

- Fonction Appel: Deepseek R1 manque de prise en charge des appels de fonction, limitant sa capacité à interagir dynamiquement avec les systèmes externes et les API.

- Analyse de sortie structurée: Contrairement au modèle O3-MINI, Deepseek R1 n'offre pas de sorties format JSON, qui restreint son utilité pour les workflows basés sur les données.

- Performance: Le modèle O3-MinI offre une latence plus faible et une meilleure optimisation, ce qui le rend plus fiable et plus efficace pour les applications de qualité de production.

Ces distinctions mettent en évidence pourquoi le modèle O3-Mini est un choix supérieur pour les tâches d'automatisation avancées, en particulier dans les scénarios où la précision, la vitesse et la flexibilité sont essentielles.

Exemple pratique: flux de travail de recommandation de film

Pour illustrer les capacités du Modèle Openai O3-Miniconsidérez un cas d'utilisation de recommandation de film. En intégrant le modèle avec l'API SERP, vous pouvez récupérer des données de film détaillées en fonction des requêtes utilisateur. En utilisant des invites système, vous pouvez demander au modèle de vous concentrer sur des critères spécifiques, tels que le genre, l'année de sortie ou le directeur. La fonction d'analyse de sortie structurée garantit que les résultats sont formatés dans JSON, ce qui les rend faciles à afficher ou à traiter davantage. Par exemple, une question comme «Recommander un film de science-fiction des années 1990» pourrait renvoyer un objet JSON avec des champs tels que: Titre de film, réalisateur, casting et runtime.

Ce niveau de précision et de personnalisation démontre l'utilité pratique du modèle O3-Mini dans les scénarios du monde réel. En utilisant ses fonctionnalités avancées, vous pouvez créer des workflows intelligents qui fournissent des résultats précis et exploitables adaptés à vos besoins spécifiques.

Crédit médiatique: Leon Van Zyl

Filed Under: AI, guides

Dernières offres de gadgets geek

Divulgation: Certains de nos articles incluent des liens d'affiliation. Si vous achetez quelque chose via l'un de ces liens, les gadgets geek peuvent gagner une commission d'affiliation. Découvrez notre politique de divulgation.

Vous pouvez lire l’article original (en Angais) sur le {site|blog}www.geeky-gadgets.com