Une victime de Jeffrey Epstein a déposé jeudi un recours collectif contre Google, affirmant que la fonctionnalité AI Mode de l'entreprise publiait des informations personnelles sur les victimes du trafiquant sexuel.

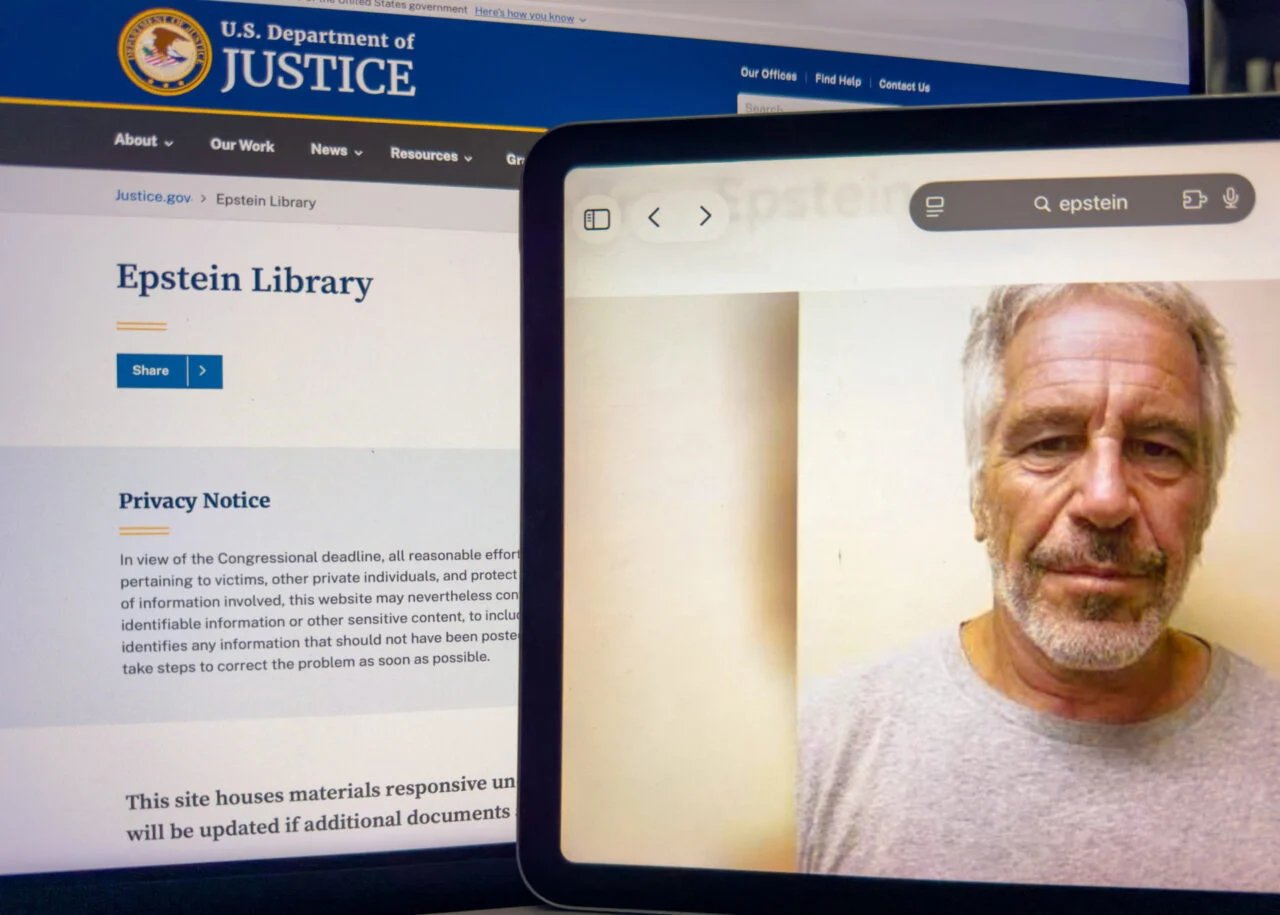

En réponse à action législativele ministère de la Justice a commencé à publier plus de 3 millions de pages de preuves dans son affaire contre Epstein par lots de la fin de l’année dernière au début de cette année. Mais le déploiement a été jugé problématique, avec les noms de certains prédateurs expurgé tandis que l'identité de plusieurs survivants a été dévoilée dans des expurgations inappropriées.

« Les États-Unis, par l'intermédiaire du DOJ, ont fait un choix politique délibéré en donnant la priorité à la divulgation rapide et massive plutôt qu'à la protection de la vie privée des survivants d'Epstein », selon le ministère de la Justice. procès déposée auprès du tribunal de district américain du district nord de Californie. Le procès affirme que les survivants ont non seulement dû revivre leur traumatisme, mais ont également été victimes de harcèlement depuis que leurs informations ont été rendues publiques.

Bien que le DOJ ait par la suite supprimé les erreurs, les informations ont été conservées en ligne par la fonction de recherche AI de Google, AI Mode, affirme le plaignant.

« Même après que le gouvernement ait reconnu que la divulgation violait les droits des survivants et retiré l'information, des entités en ligne comme Google la republient continuellement, refusant les demandes des victimes de la supprimer », indique le procès.

En recherchant le nom de la plaignante, qui s'appelle «Jane Doe», ainsi que les noms des autres victimes qu'elle représente dans ce procès, le mode AI de Google a affiché leur «nom complet, leurs coordonnées, leurs villes de résidence et leur association avec Jeffrey Epstein», selon la poursuite. Dans le cas du plaignant, l'IA a également « généré un lien hypertexte permettant à quiconque d'envoyer un e-mail direct au plaignant en cliquant sur un bouton ».

Le procès affirme que la victime a informé Google du problème à plusieurs reprises au cours des deux derniers mois, en vain.

« Bien qu'il ait été informé des violations, du préjudice substantiel causé par sa diffusion continue et du statut de nombreux membres du groupe en tant que survivants d'abus sexuels ayant droit à des protections accrues de la vie privée en vertu de la loi, Google a échoué et refuse de supprimer, de désindexer ou de bloquer l'accès aux documents incriminés », affirme la poursuite. « En particulier, plusieurs autres outils d'IA accessibles au public qui génèrent du contenu en analysant des sources en ligne, tels que ChatGPT, Claude et Perplexity, n'ont fourni aucune information relative aux victimes lors de tests répétés similaires. »

Contrairement à la recherche Google, le mode IA « n’est pas un index de recherche neutre ; c’est un outil de recommandation actif et un générateur de contenu », affirme le procès, et pourrait être plaidé comme un « doxxing exploitable ».

Le procès intervient à la fin d'une semaine où la responsabilité juridique des géants de la technologie à l'égard du contenu en ligne a été mise à l'épreuve. Meta et Google ont été reconnus responsables lors d'un procès pour dépendance aux médias sociaux à Los Angeles mercredi, et Meta a été reconnu responsable lors d'un procès en ligne sur la sécurité des enfants au Nouveau-Mexique mardi.

Les deux procès ont été considérés comme des procès historiques qui pourraient devenir un moment décisif dans la manière dont la liberté d’expression en ligne est réglementée aux États-Unis. Actuellement, en vertu de l'article 230 du Communications Decency Act, les grands géants de la technologie comme Google qui exploitent ces plateformes en ligne sont dégagés de toute responsabilité concernant le contenu publié par des tiers. Avec les décisions rendues cette semaine contre Meta et Google, la protection que les géants de la technologie reçoivent de la section 230 est désormais sérieusement remise en question.

L'applicabilité de l'article 230 à l'IA a fait l'objet de discussions contention. Le sénateur Ron Wyden, qui a contribué à la rédaction de la loi, a déclaré à Gizmodo en janvier que les chatbots IA n'y étaient pas protégés.

Le ministère de la Justice et Google n'ont pas immédiatement répondu à la demande de commentaires de Gizmodo.

Vous pouvez lire l’article original (en Angais) sur le sitegizmodo.com